Ve dnech od 27. až 31. března se na půdě OECD uskutečnila virtuální mezinárodní konference o umělé inteligenci v práci, inovacích, produktivitě a dovednostech. Na konferenci se sešli přední představitelé politických, akademických, obchodních, technických i občanských kruhů, aby diskutovali o tom, jak umělá inteligence ovlivňuje zaměstnanost, dovednosti či inovace a jak na tyto změny může reagovat tvorba politik.

Diskutující se zaměřili například na nástroje podobné ChatGPT, který představuje nejnovější formu umělé inteligence. Tyto generativní nástroje umělé inteligence jsou využívány na podporu soudních rozhodnutí, pomáhají zájemcům s přijímacími zkouškami na vysoké školy či v minulosti zvítězily v uměleckých soutěžích. S rozvojem technologií a vznikem nových nástrojů je proto nezbytné, aby jednotliví mezinárodní aktéři došli k porozumění, jak tyto technologie využívat, aby byly prospěšné a bezpečné.

Algoritmická odpovědnost v EU

Umělá inteligence razí cestu na pracovním trhu a je proto třeba v této oblasti přijít s jasně formulovanou odpovědností pro její aktéry. Jedním z hlavních cílů je ujistit se, aby bylo díky nastavení algoritmické odpovědnosti zajištěno, že umělá inteligence nebude poškozovat pracovníky z hlediska fyzického zdraví a bezpečnosti. Odpovědnost je rovněž nezbytná k tomu, aby bylo možné zjednat nápravu v případě, že má umělá inteligence nepříznivý dopad na pracovníky nebo uchazeče o zaměstnání. Předcházet se musí i situacím, kde by mohla způsobit přímou diskriminaci na pracovním trhu. V panelu o algoritmické odpovědnosti Yordanka Ivanova z Evropské komise a Sandra Wachter z Oxfordské univerzity diskutovaly o tom, jak stávající a navrhované právní předpisy řeší odpovědnost za užívání umělé inteligence na pracovišti. Debatu moderovala Angelica Salvi Del Pero z OECD.

Hlavní prioritou v oblasti umělé inteligence by dle panelistů mělo být vyvinutí legálního rámce pro její fungování. Algoritmická odpovědnost by se měla přímo vázat na fungování umělé inteligence v případě, že vytvoří nerovné podmínky či zcela selže. Na počátku debaty byl směrem k divákům vznesen dotaz, kdo by měl nést odpovědnost, pokud nástroj umělé inteligence povede k diskriminaci v procesu přijímání zaměstnanců. Většina dotazovaných odpověděla, že odpovědnými subjekty by měla být kombinace aktérů, čtvrtina se domnívá, že by odpovědnost měla jít za společností, která nástroj umělé inteligence přijala, a pouhých 5 % by odpovědnost přeneslo na vysokého manažera společnosti.

Akt EU o umělé inteligenci

V současné době šetření odpovědnosti obvykle začíná a končí u osoby, která algoritmus používá. Evropská unie však dlouhodobě rozvíjí své politiky na poli umělé inteligence, tak aby byla uživatelům těchto softvérů schopna poskytnou pevnější právní rámec. Hlavním výsledkem této agendy je Akt EU o umělé inteligenci, který představuje první dokument svého druhu stavující pravidla v této oblasti na světě. Zákon například zakazuje aplikace a systémy, které vytvářejí nepřijatelné riziko, jako je například vládní sociální skóring používaný v Číně. Vysoce rizikové aplikace, jako je nástroj pro skenování životopisů, který hodnotí uchazeče o zaměstnání, podléhají zvláštním právním požadavkům, aby nedocházelo k diskriminaci. A konečně aplikace, které nejsou výslovně zakázány nebo uvedeny jako vysoce rizikové, zůstávají z velké části neregulovány. O pokrok v této agendě se významně zasadilo právě české předsednictví v Radě Evropské unie, během kterého Česká republika vyjednala tzv. obecný přístup členských států v Radě.

V navrhovaném zákoně však existuje i několik mezer a výjimek. Dle Yordanky Ivanovy se Akt o umělé inteligenci snaží především myslet na různé hráče a většina rámce je tak zaměřena na vývojáře a tvorbu systému než na samotné koncové uživatele. Často tak dochází k natahování povinností a nejasné definici koncové odpovědnosti.

Potřeba řešit otázky spojené s odpovědným využíváním umělé inteligence je pro státy, občany i podniky v posledních letech stále důležitější a dostává se tak častěji na mezinárodní pole. Evropská unie dále pracuje i na tom, aby se normy v jednotlivých zemích vzájemně doplňovaly a dorozumívaly. Na standardech v oblastech umělé inteligence pracují například i Spojené státy americké, kde byl v uplynulých měsících zveřejněn návrh na tzv. AI Bill of Rights, který by měl představovat dokument poskytující důležitý rámec pro to, jak mohou vláda, technologické společnosti a občané spolupracovat na zajištění odpovědnější umělé inteligence.

Zdroj: OECD

Autorka: Barbora Novotná, Euroskop.cz

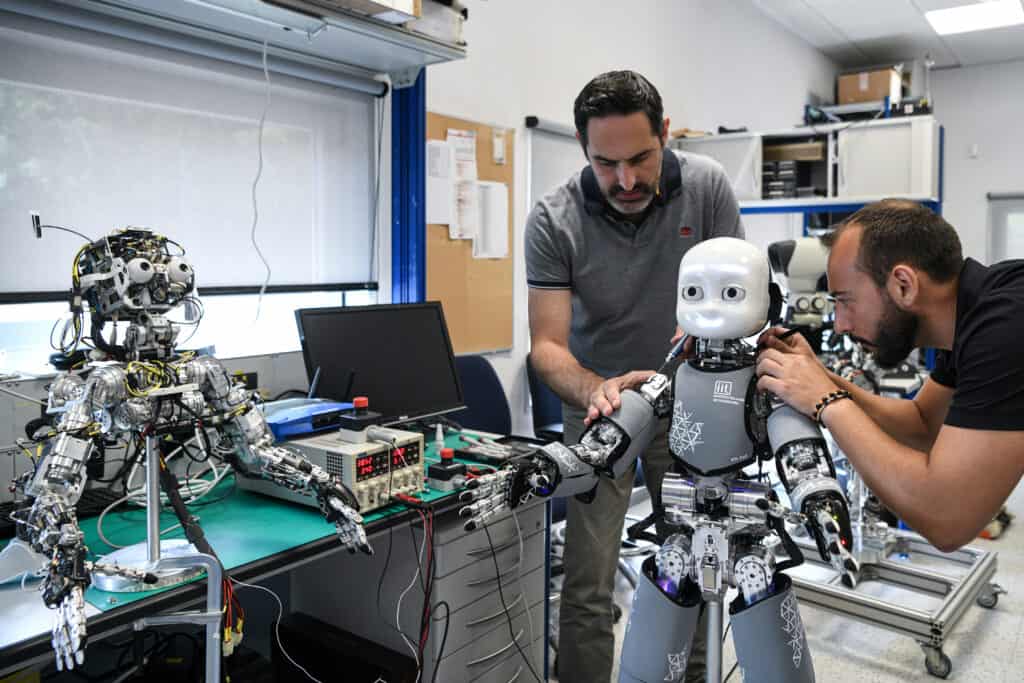

Ilustrační foto: Evropská komise